学习本章内容之前,必须掌握如何在虚拟机里安装linux操作系统。安装过程参考以下博文: VirtualBox安装CentOS7

1.安装JDK

首先安装glibc.i686,glibc是gnu发布的bailibc库,即c运行库。duglibc是linux系统中最底zhi层的api,几乎其它任何运行库都dao会依赖于glibc。

yum install glibc.i686

安装JDK的步骤参照以下博文: CentOS安装JDK8

2.设置免密登录

linux有免密登录,这个功能在搭建hadoop集群时很有用,因为有了它远程启动集群或做其他操作就不需要一遍遍的输入密码了。

实现步骤:

mkdir /root/.ssh

ssh-keygen #四个回车,中间啥都不要输入

ssh-copy-id -i localhost

ssh localhost #登录中,如果不让输入密码说明免登录成功

3.安装hadoop实现伪分布式环境

下载或者上传hadoop-2.7.2.tar.gz至/root/download

解压缩hadoop-2.7.2.tar.gz到/usr/local

tar -zxvf hadoop-2.7.2.tar.gz -C /usr/local

伪分布式需要在/usr/local/hadoop-2.7.2/etc/hadoop下修改5个配置文件:hadoop-env.sh、core-site.xml、hdfs-site.xml、mapred-site.xml和yarn-site.xml

配置hadoop-env.sh

vim hadoop-env.sh

#第27行

export JAVA_HOME=/usr/local/jdk1.8.0_181

配置core-site.xml,configuration标签里添加。

<!-- 制定HDFS的老大(NameNode)的地址 -->

<property>

<name>fs.defaultFS</name>

<!--simoniu为linux主机名字-->

<value>hdfs://localhost:9000</value>

</property>

<!-- 指定hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/hadoop-2.7.2/tmp</value>

</property>

配置hdfs-site.xml。

<property>

<name>fs.checkpoint.period</name>

<value>3000</value>

</property>

<!-- 指定HDFS副本的数量(集群下,有多台机,可多份,目前就一台)-->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

配置mapred-site.xml 默认mapred-site.xml不存在,使用一下命令生成。

mv mapred-site.xml.template mapred-site.xml

vim mapred-site.xml,configuration标签里添加。

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

配置yarn-site.xml vim yarn-site.xml,configuration标签里添加。

<!-- 指定YARN的老大(ResourceManager)的地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>localhost</value>

</property>

<!-- reducer获取数据的方式是shuffle方式 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>localhost:8088</value>

</property>

4.hadoop添加到环境变量

vim /etc/profile

export JAVA_HOME=/usr/local/jdk1.8.0_181

export HADOOP_HOME=/usr/local/hadoop-2.7.2

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

source /etc/profile

5.启动hadoop

#先启动HDFS

sbin/start-dfs.sh

#再启动YARN

sbin/start-yarn.sh

或者使用start-all全都启动命令

sbin/start-all.sh

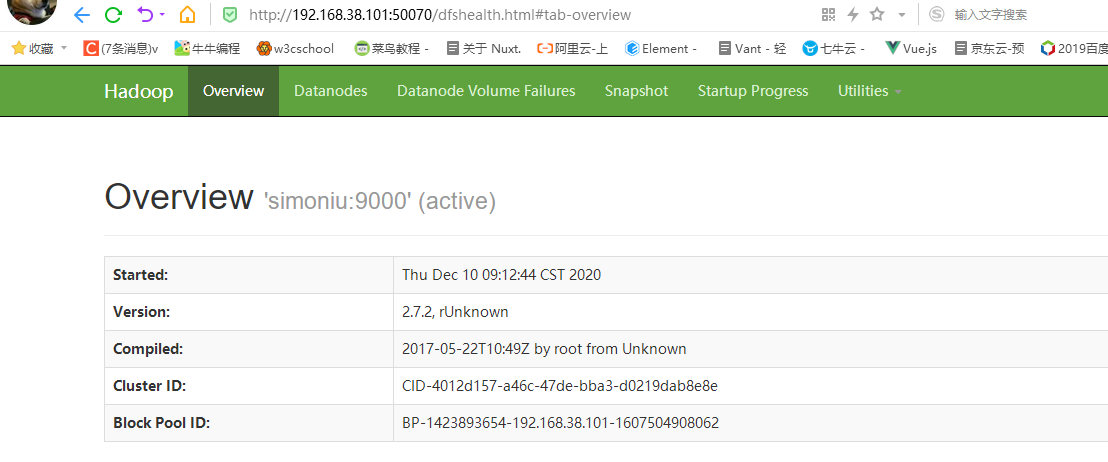

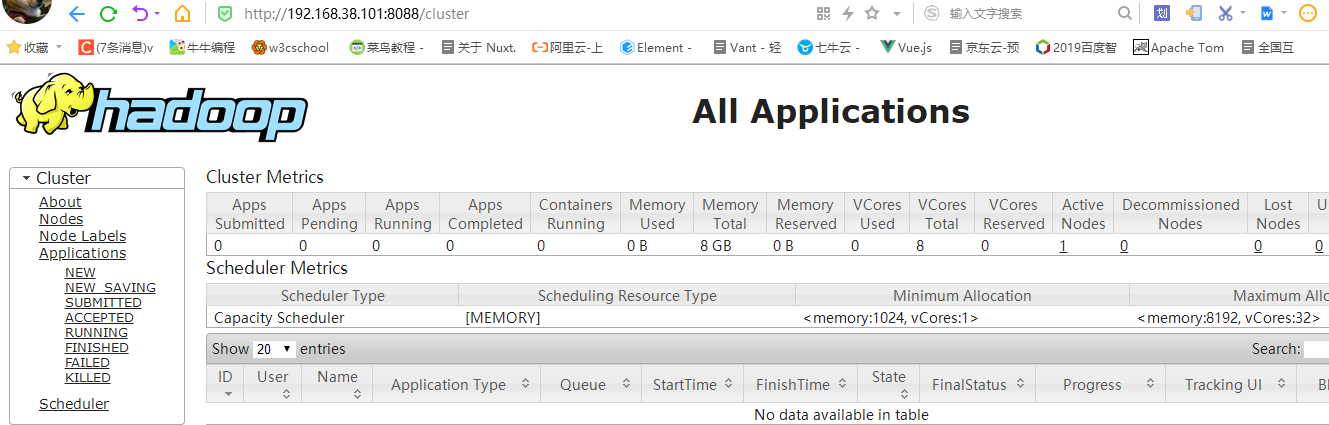

在浏览器输入以下两个网址。 http://192.168.38.101:50070 (HDFS管理界面) http://192.168.38.101:8088 (MR管理界面)

出现以下界面效果,说明hadoop环境搭建成功!