windows本地部署Chat-GLM3

windows本地部署Chat-GLM3

1.Chatglm3-6B本地部署

Chatglm3-6B大模型介绍: 网址:https://zhipu-ai.feishu.cn/wiki/WvQbwIJ9tiPAxGk8ywDck6yfnof

1.1 本地部署Chatglm3-6B大模型环境准备

步骤1:使用Conda创建虚拟环境。

# 安装 Miniconda 或 Anaconda 后,创建新的虚拟环境

conda create --name AI_env python=3.11.9

# 激活虚拟环境

conda activate AI_env

步骤2:安装必要依赖。

使用以下命令安装所需的依赖库 安装 pytorch cpu版本(可选)。

pip install torch

安装 pytorch gpu版本(可选,如果有CUDA)。

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

安装 transformers:

#注意:这里transformers必须安装低版本4.40.2

pip install transformers==4.40.2

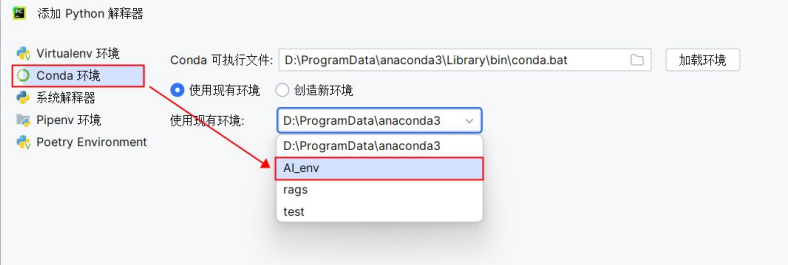

步骤3:在Pycharm中使用创建的环境 在设置中添加刚创建的虚拟环境。

1.2 下载Chatglm3-6B模型

为了加快下载速度,我们使用魔搭社区的下载方式。

pip install modelscope

下载模型:

from modelscope.hub.snapshot_download import snapshot_download

llm_model_dir = snapshot_download('ZhipuAI/chatglm3-6b',cache_dir='models')

ZhipuAI/chatglm3-6b为魔搭社区上的路径。models为本地路径。下载完毕(下载过程中最好不要有断网等操作):

1.3 模型推理

from transformers import AutoTokenizer, AutoModel

# 使用预训练模型chatglm3-6b的分词器实例化tokenizer对象。

tokenizer = AutoTokenizer.from_pretrained("models/ZhipuAI/chatglm3-6b", trust_remote_code=True)

# 实例化一个预训练的模型

model = AutoModel.from_pretrained("models/ZhipuAI/chatglm3-6b", trust_remote_code=True).half().cuda()

#model = AutoModel.from_pretrained("models/ZhipuAI/chatglm3-6b", trust_remote_code=True).half().cpu()

model = model.eval()

response, history = model.chat(tokenizer, "你好", history=[])

print(response)

运行效果:

(llama-factory) root@autodl-container-5fd24885db-13f1ee09:~/autodl-tmp/LLaMA-Factory# python glm_infer.py

Loading checkpoint shards: 100%|██████████████████████████████████████████████████████████████████████████████████████████████| 7/7 [00:02<00:00, 3.07it/s]

你好!我是人工智能助手 ChatGLM3-6B,很高兴见到你,欢迎问我任何问题。