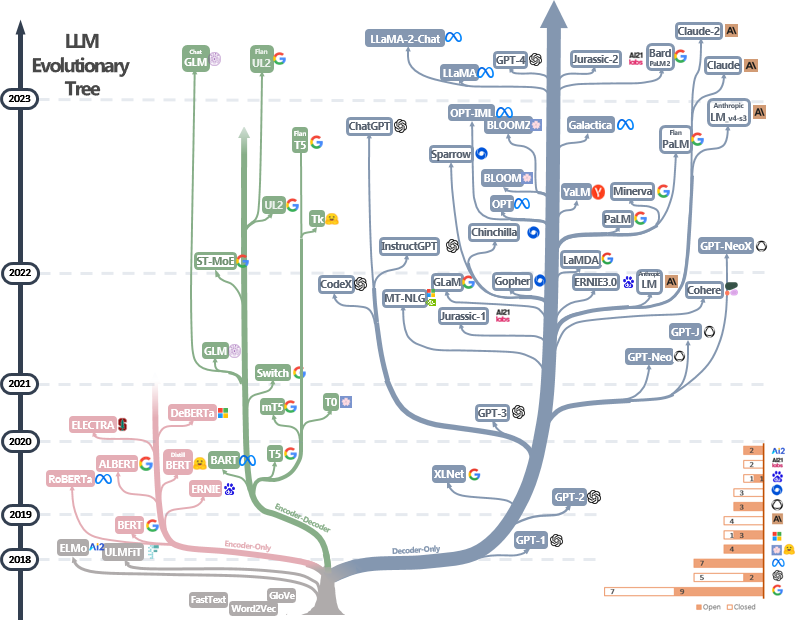

1.大语言模型进化树

这些语言模型主要分为三类。一是“仅编码器(encoder-only)”组(上图中的粉色部分),该类语言模型擅长文本理解,因为它们允许信息在文本的两个方向上流动。二是“仅解码器(decoder-only)”组(上图中的蓝色部分),该类语言模型擅长文本生成,因为信息只能从文本的左侧向右侧流动,以自回归方式有效生成新词汇。三是“编码器-解码器(encoder-decoder)”组(上图中的绿色部分),该类语言模型对上述两种模型进行了结合,用于完成需要理解输入并生成输出的任务,例如翻译。

这一切都主要始于文本理解类模型。最初是使用RNN的ELMo,之后是谷歌著名的BERT模型及其派生模型(如RoBERTa),它们都基于Transformer。这些模型通常具有几亿个参数(相当于约1GB的计算机内存),在大约10GB到100GB的文本上进行训练(通常为几十亿个单词),并且可以在现代笔记本电脑上以约0.1秒的速度处理一段文本。这些模型极大地提升了文本理解任务的性能,如文本分类、实体检测和问题回答等。这已然是NLP(自然语言处理)领域的一场革命,不过才刚刚拉开序幕……

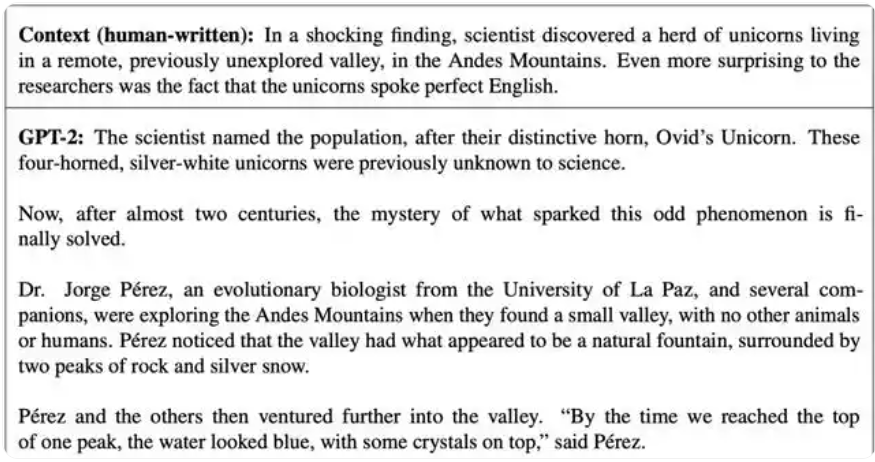

在文本理解类语言模型发展的同时,OpenAI开始基于Transformer创建文本生成类语言模型。首先是2018年的GPT-1,有1亿个参数;然后是2019年的GPT-2,拥有高达15亿个参数,并在40GB的文本上进行了训练。至少对我来说,GPT-2的创建是一个至关重要的时刻。以下是GPT-2可以生成的文本示例,从一个由人类撰写的段落开始:

生成的英语文本质量很不错,而且具有连贯性。例如,科学家的名字没有改变,而这在基于RNN的模型中是个经典问题。由于GPT-2在所生成文本的质量上取得了巨大突破,为避免滥用,OpenAI最初决定不向公众发布。可以说GPT-2标志着LLM正朝着正确的方向发展。需要注意的是:使用这类语言模型需要先提供一个起始文本,这个起始文本被称为提示(prompt)。

一年后(2020年),OpenAI创建了GPT-3。GPT-3是一个具有1750亿个参数的模型(需要700GB的计算机内存来存储模型!),该模型不仅规模显著扩大,文本生成质量也有重大改进。除了性能的提升外,GPT-3还让人们对未来如何使用LLM大开眼界。

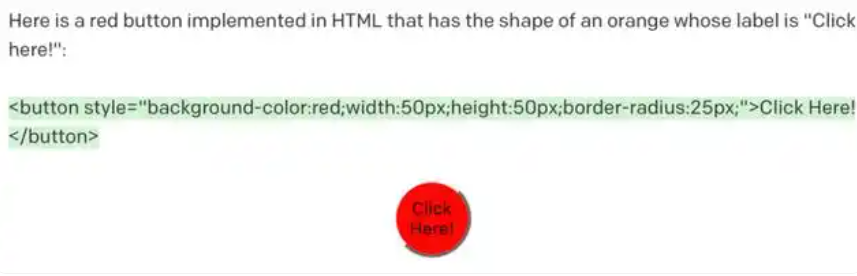

首先,GPT-3能够编写代码。例如,你可以使用GPT-3来生成(非常)简单的网站,只需在提示中描述网站的外观即可。以下是一个示例,让GPT-3使用HTML创建一个按钮:

这些基本的编码能力在当时并不十分实用,但它们的出现意味着软件开发在未来可能会发生根本性转变。

GPT-3另一令人瞩目的能力是能够进行上下文学习,它可以通过提示中所展示的示例来学习如何执行任务。这意味着你可以通过编写提示来定制LLM,而无需更改它们的权重。这一能力开辟了一种全新的、完全基于提示的自然语言处理方式,如今十分受欢迎。

总而言之,GPT-3展示了“提示”作为一种新方式的潜力,可以让机器通过自然语言按照我们的意愿执行任务。

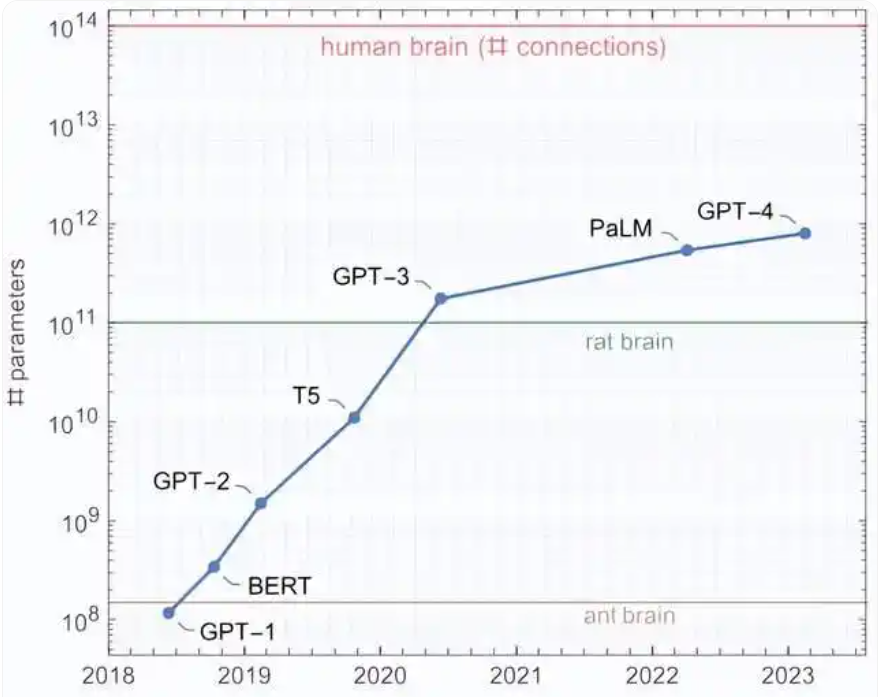

注意:GPT-3比GPT-2要大得多。自2018年以来,模型的规模急剧增加。以下是一些值得关注的LLM及其规模:

在两年时间里,模型参数的数量增加了1000倍,目前最大的模型(如GPT-4)已接近1万亿个参数,这是因为模型规模的增加与性能的改善密切相关,并且目前还未达到性能瓶颈。这些模型规模十分庞大,与人脑相比,人脑约有1000亿个神经元,每个神经元平均与其他1000个神经元相连接,总共约有100万亿个连接。从某种意义上说,最大的LLM仍然比人脑小100倍。当然,这只是一个非常宽泛的比较,因为人脑和当前LLM使用的架构和学习方法都截然不同。

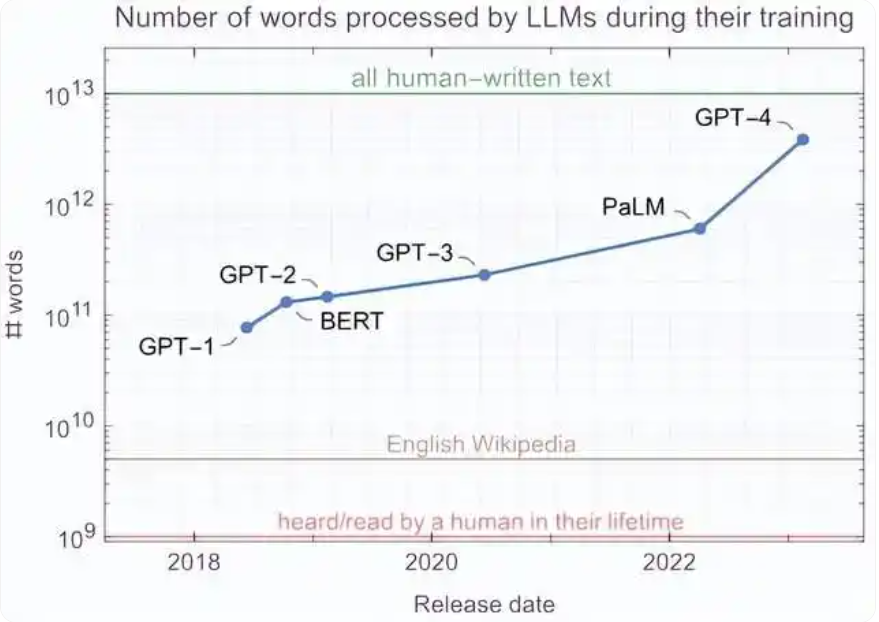

另一个有趣的指标是这些模型在训练阶段所“阅读(read)”的单词数量。

如你所见,数量十分庞大。这些模型在训练过程中会接触超1000亿个单词,是一个人在一生中听到或阅读单词数量的100倍以上!这显示出神经网络与人脑的不同之处:神经网络的学习速度比人类慢得多,但可以获得比人类接触的多得多的数据。

需要注意的是,LLM在训练过程中所接触到的单词数量并未像参数数量那样迅速增长(从GPT-1到GPT-3只增长了3倍)。这是因为优先考虑模型规模,不过结果证明这是一个小小的失误。最新的模型并没有比GPT-3大很多,但通过处理更多单词来进行训练。

这种对数据的渴求导致了一个问题,即可用文本的总量存在硬性限制,约为数万亿个单词,而模型正在接近这一限制。虽然仍有可能循环遍历所有文本,但这会导致模型性能的回报递减。总而言之,可得出结论:网络在训练阶段处理的有效限制是几十万亿个单词,比GPT-4的数量约多出10倍。

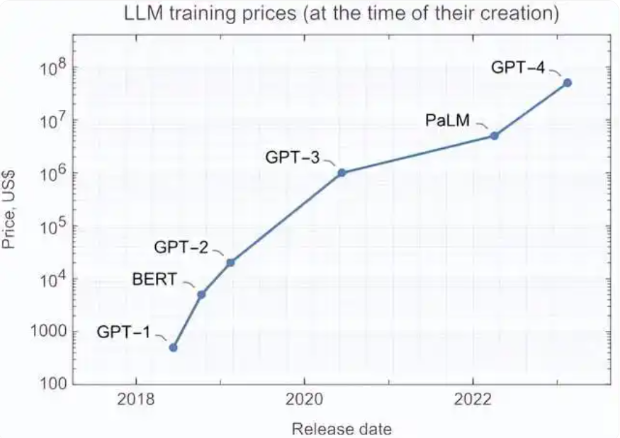

另一个问题是,通过用更多的数据训练更大的模型,计算成本也在增加。以下是训练上述模型的预估计算成本:

为显著超越当前模型的性能,下一代模型需要耗费数亿美元的计算资源。虽然考虑到这些模型能带来的好处,这一成本是合理的,但如此巨大的花费仍然是一个问题。

模型的扩展变得越来越困难。幸运的是,扩大规模并不是改进LLM的唯一途径。2022年末,一项创新开启了另一场革命,这次的影响远远超出了NLP领域。那就是模型微调与优化。

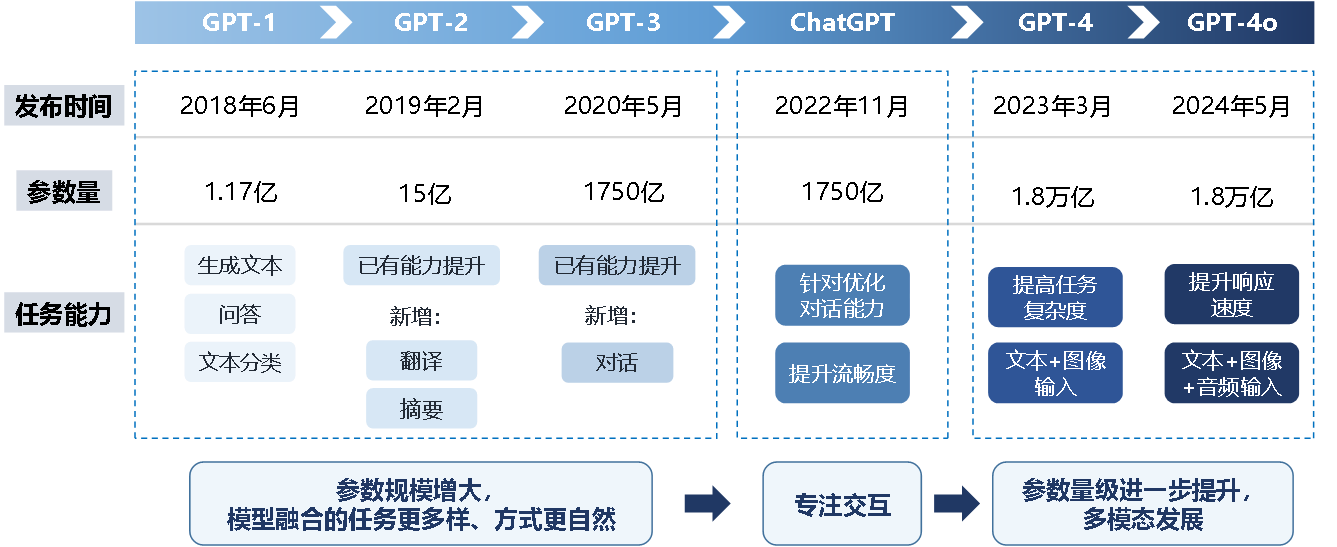

最后,我们总结一下OpenAI的ChatGPT整个历史发展的脉络演变过程如下:

2.大模型发展的历史阶段

1. 统计语言模型阶段(1990s-2000s)

特点:基于统计方法,利用词频和共现信息建模语言。 代表性算法: - N-gram 模型:基于马尔可夫假设,用前 n−1n−1 个词预测第 nn 个词。 - 隐马尔可夫模型(HMM):用于序列标注任务(如词性标注)。 - 最大熵模型(MaxEnt):结合多种特征进行概率建模。

2. 浅层神经网络阶段(2000s-2010s)

特点:引入神经网络,但仍以浅层结构为主。 代表性算法: - Word2Vec:通过 Skip-Gram 和 CBOW 模型学习词向量。 - GloVe:基于全局词共现矩阵学习词向量。 - FastText:将词表示为子词向量的和,适合处理未登录词。

3. 深度学习阶段(2010s-2017)

特点:使用深层神经网络捕捉复杂的语言模式。 代表性算法: - RNN/LSTM:通过递归结构处理序列数据,解决长距离依赖问题。 - GRU:LSTM 的简化版本,计算效率更高。 - Seq2Seq:用于机器翻译等序列到序列任务。 - Attention 机制:提升模型对关键信息的关注能力。

4. 预训练大模型阶段(2018-至今)

特点:通过大规模预训练和微调,实现通用语言理解与生成。 代表性算法: - Transformer:基于自注意力机制,彻底取代 RNN 成为主流架构。 - BERT:双向 Transformer,通过掩码语言模型(MLM)预训练。 - GPT 系列:自回归 Transformer,通过语言模型预训练。 - T5:将多种 NLP 任务统一为文本到文本的格式。 - BART:结合双向和自回归预训练,适合生成任务。

5. 多模态大模型阶段(2020-至今)

特点:融合文本、图像、音频等多模态信息,实现更通用的 AI。 代表性算法: - CLIP:通过对比学习对齐文本和图像表示。 - DALL·E:根据文本生成图像。 - Whisper:多语言语音识别与翻译。 - GPT-4:支持多模态输入(如图像+文本)。

3.大模型代表性算法详解

1. Transformer

- 核心思想:通过自注意力机制捕捉全局依赖关系,摆脱 RNN 的序列计算限制。

- 优点:并行计算能力强,适合处理长序列。

- 应用:机器翻译、文本生成。

2. BERT

- 核心思想:双向 Transformer,通过掩码语言模型(MLM)和下一句预测(NSP)预训练。

- 优点:上下文感知,适合理解任务。

- 应用:文本分类、问答系统。

3. GPT 系列

- 核心思想:自回归 Transformer,通过语言模型预训练。

- 优点:生成能力强,适合文本生成任务。

- 应用:对话系统、代码生成。

4. T5

- 核心思想:将多种 NLP 任务统一为文本到文本的格式。

- 优点:任务泛化能力强,适合多任务学习。

- 应用:文本摘要、翻译、分类。

5. CLIP

- 核心思想:通过对比学习对齐文本和图像表示。

- 优点:跨模态理解能力强,适合图文检索。

- 应用:图像分类、图文生成。

4.常见的开源模型

开源大模型和闭源大模型是人工智能领域中两种不同的模型发布和使用方式:

1.开源大模型(Open-Source Large Models)

定义:开源大模型是指那些源代码和训练数据对公众开放,允许任何人自由使用、修改和分发的模型。

2.闭源大模型(Closed-Source Large Models)

定义:闭源大模型是指那些由特定组织或公司开发,不公开源代码和训练数据,通常需要付费或通过特定许可才能使用的模型。

可以简单理解为iOS跟安卓的关系。

开源大模型,一般来说可以分为底座模型以及行业微调模型。

底座模型是通常指的是一个基础的、通用的预训练模型,它作为构建更专业或特定领域模型的起点。

一些常见的底座开源模型列表如下:

行业微调模型是指的在底座模型基础上,使用特定行业的数据集进行进一步的训练,以使模型适应特定任务或领域的过程。这种微调可以使模型更好地捕捉该领域的语言特点、专业术语和语义关系,从而提升在该领域应用的性能。