Transformer 模型自问世以来,已经是人工智能领域的最核心技术之一。作为深度学习中革命性的架构,Transformer 不仅在自然语言处理(NLP)中占据主导地位,还扩展到了计算机视觉、语音处理和科学计算等多个领域。

1.Transformer简介

Transformer是谷歌在2017年的论文《Attention Is All You Need》中提出的,用于NLP的各项任务,现在是谷歌云TPU推荐的参考模型。自2017年Google推出Transformer以来,基于其架构的语言模型便如雨后春笋般涌现,其中Bert、T5等备受瞩目,而2023年风靡全球的大模型ChatGPT和LLaMa更是大放异彩,到目前 Vision Transformer 在图像分析中的崛起,可以说Transformer 的影响力无处不在。同时,研究者们也在不断优化和改进这一架构,通过轻量化设计、高效注意力机制以及多模态融合,进一步拓宽了其应用场景和效率边界。Transformer 已经从一种模型架构发展为一种贯穿多领域的技术范式,其热度不仅未减,反而随着新技术和新应用的涌现而持续升温。

2.Transformer网络架构

循环神经网络和长短期记忆网络已经广泛应用于时序任务,比如文本预测、机器翻译、文章生成等。然而,它们面临的一大问题就是如何记录长期依赖。

为了解决这个问题,Transformer架构应运而生。从那以后,Transformer 被应用到多个自然语言处理方向,到目前为止还未有新的架构能够将其替代。可以说,它的出现是自然语言处理领域的突破,并为新的革命性架构(BERT、GPT-3、T5等)打下了理论基础。

Transformer 完全依赖于注意力机制,并摒弃了循环。它使用的是一种特殊的注意力机制,称为自注意力(self-attention)。

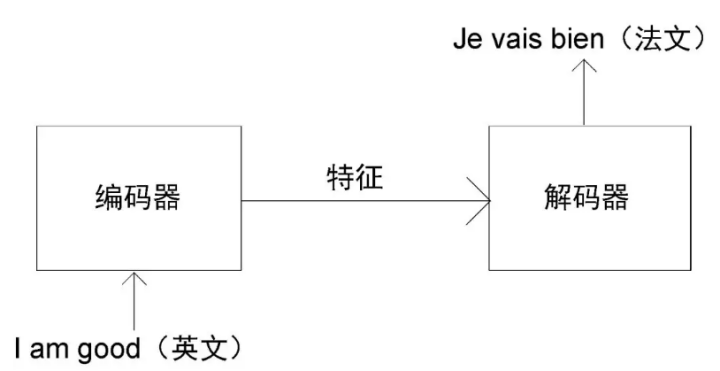

Transformer 由编码器(Encoder)和解码器(Decoder)两部分组成。我们先说结论:

- 编码器的作用是提取特征。

- 解码器的作用是基于编码器提取的特征,逐步生成目标序列。

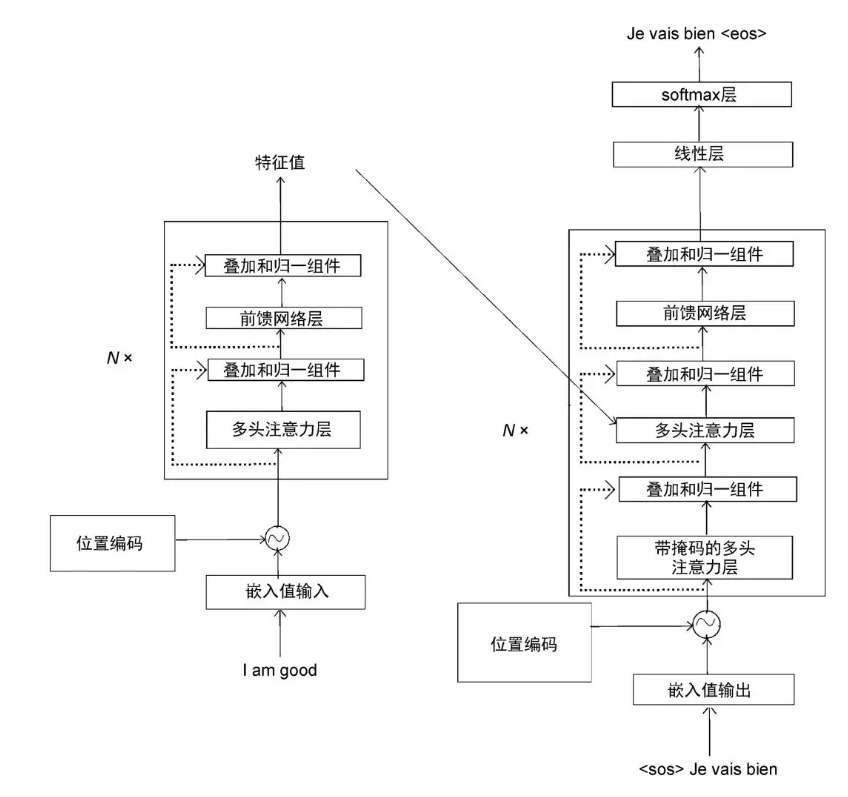

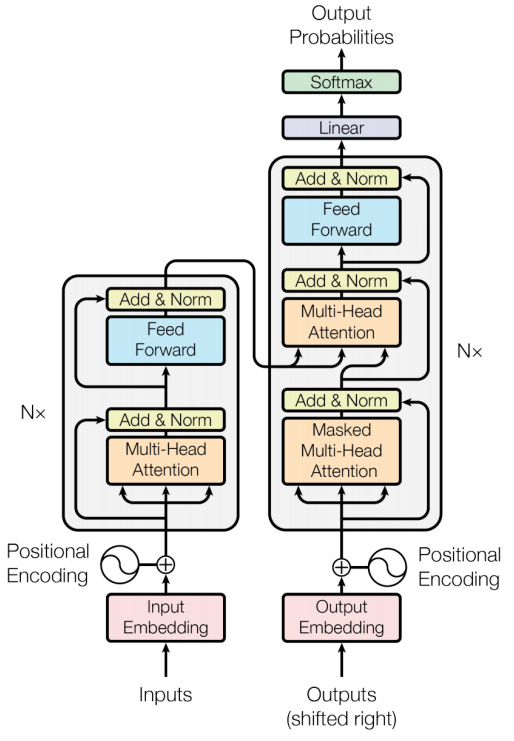

假设我们需要将一个句子 从英文翻译为法文。如下图所示,首先,我们需要将这个英文句子(原句)输进编码器。编码器将提取英文句子的特征并提供给解码器。最后,解码器通过特征完成法文句子(目标句)的翻译。

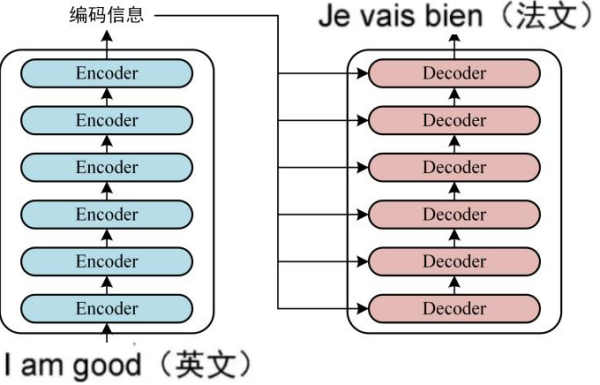

我们把这个图再细化一下如下:

可以看到 Transformer 由 Encoder 和 Decoder 两个部分组成,Encoder 和 Decoder 都包含 6 个 block。

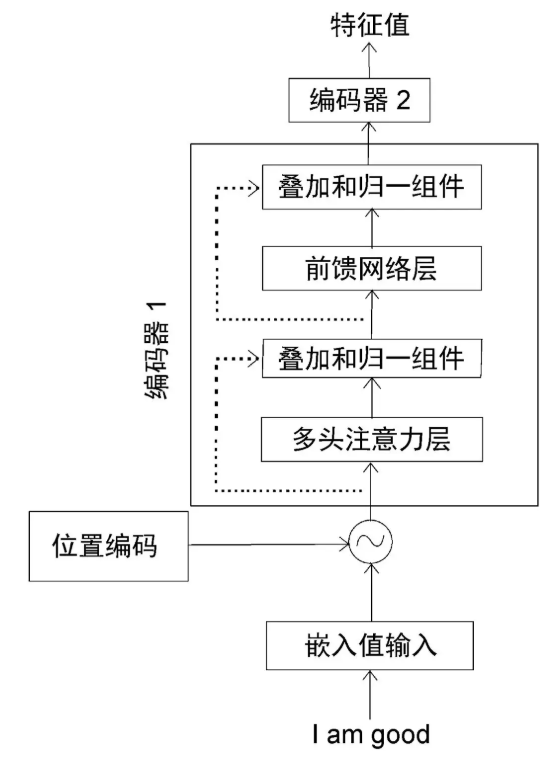

编码器总览

下图显示了叠加的两个编码器,但只有编码器 1 被展开,以便你查看细节。

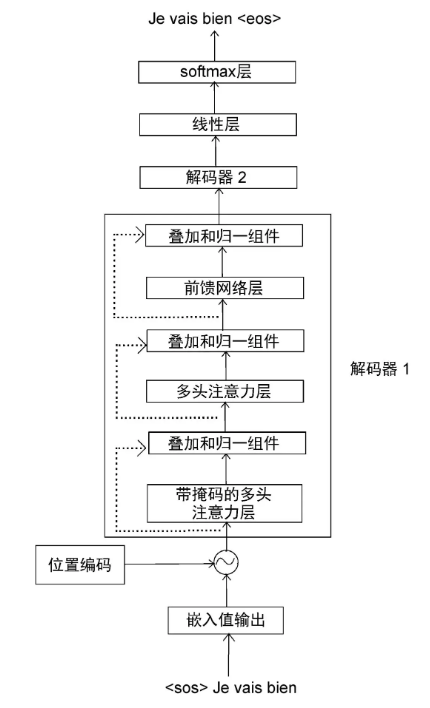

解码器总览

下图显示了两个解码器。为了避免重复,只有解码器 1 被展开说明。

整合编码器和解码器的整体网络架构

整合编码器和解码器的整体网络架构(英文原版)

3.Transformer与RNN对比

- RNN、LSTM、BiLSTM、GRU:都属于循环神经网络(Recurrent Neural Networks, RNNs),依赖循环结构处理序列数据。

- Transformer:属于 基于注意力机制的神经网络(Attention-Based Neural Networks),通过自注意力机制实现对序列的建模。

虽然 Transformer 和 RNN 是两种不同的架构,但它们并非完全对立。在某些场景下,也可以将两者结合使用,例如在 Transformer 的输入层使用 RNN 进行特征提取。

4.为什么Transformer更受欢迎?

- Transformer 的并行计算能力使其在大规模数据和长序列任务中效率更高。

- 自注意力机制能够捕捉全局依赖关系,而 RNN 及其变体在长序列中容易出现梯度消失或信息丢失的问题。

- Transformer 在自然语言处理(NLP)领域取得了突破性进展(如 BERT、GPT 等),逐渐取代了传统的 RNN 架构。