循环神经网络(RNN,Recurrent Neural Network)是一种用于处理序列数据的神经网络架构。它特别适用于时间序列分析、自然语言处理(NLP)等领域,因为它能够处理序列数据中的时间或顺序依赖性。RNN通过在网络的隐藏层之间传递信息,使得网络能够对序列中前面的信息有所记忆,这对于预测下一个元素、生成文本或理解句子结构等任务非常有用。

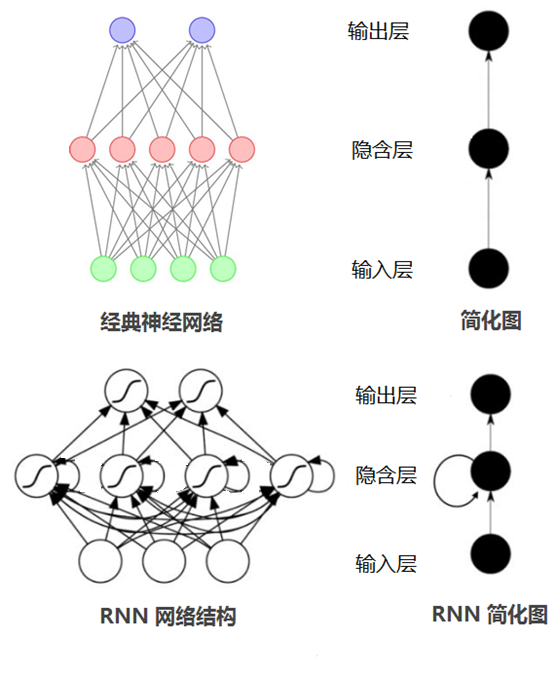

1.传统神经网络的缺陷

传统的神经网络(如多层感知机,MLP)在处理时序数据时存在一些显著的局限性,主要原因是它们的设计没有考虑时间维度的特性。以下是传统神经网络难以处理时序数据的原因: 1. 缺乏记忆机制 传统的神经网络(如多层感知机)是基于静态输入输出的模型,它们假设输入和输出之间是独立的,没有时间上的依赖关系。 时序数据(如语音、视频、股票价格等)具有时间上的依赖性,即当前的输出可能依赖于过去的输入。传统神经网络无法记忆过去的输入,因此无法捕捉这种时间依赖关系。 2. 无法处理动态长度的输入 时序数据的长度通常是动态的,例如一段语音信号可能有几秒钟,也可能有几分钟。传统神经网络的输入是固定大小的,无法直接处理这种动态长度的输入。 3. 无法建模长期依赖关系 时序数据中可能存在长期依赖关系,例如在自然语言处理中,一个句子的含义可能依赖于前面的多个单词。传统神经网络无法有效建模这种长期依赖关系,因为它们没有机制来存储和利用过去的上下文信息。 4. 忽略时间维度的结构 时序数据的结构是时间序列,每个时间点的数据可能与前后时间点的数据相关。传统神经网络将输入视为独立的特征向量,忽略了时间维度的结构,导致无法捕捉时间上的模式。 5. 无法处理因果关系 时序数据通常具有因果关系,即未来的输出不能依赖于未来的输入。传统神经网络无法自然地处理这种因果关系,因为它们没有时间上的方向性。

解决方法:

为了解决这些问题,研究者们开发了专门用于处理时序数据的神经网络架构,例如: - 循环神经网络(RNN):引入了记忆机制,可以处理动态长度的输入,并捕捉时间上的依赖关系。 - 长短期记忆网络(LSTM)和 门控循环单元(GRU):改进了 RNN 的记忆能力,能够更好地建模长期依赖关系。 - Transformer:通过自注意力机制,能够同时捕捉时间序列中的全局依赖关系。

总结来说,传统神经网络难以处理时序数据的根本原因是它们的设计没有考虑时间维度的特性,而专门的时序模型(如 RNN、LSTM 和 Transformer)通过引入记忆机制和时间感知能力,能够有效解决这些问题。

2.RNN的核心思想

RNN(循环神经网络)的核心思想就是:记住过去,影响现在。 RNN的核心特性就是:一维性和时序性。

想象你和一个聊天机器人对话。聊天机器人需要根据你之前说过的内容来生成合适的回复。比如: - 你:“今天天气怎么样?” - 聊天机器人:“今天晴天,适合出门。” - 你:“那我需要带伞吗?” - 聊天机器人:“不需要,今天没有雨。”

这里,聊天机器人需要记住你之前的提问(“今天天气怎么样?”),才能正确回答“需要带伞吗?”如果它完全忘记了之前的对话内容,就可能回答“我不知道你在说什么”,这就和传统神经网络一样——它无法记住过去的输入。 RNN的特别之处就在于:它能记住过去的输入,并用这些记忆来影响当前的输出。就像聊天机器人会把之前的对话内容“记在心里”,然后根据这些记忆来生成回复。这个“记忆”是通过RNN内部的一个隐藏状态(hidden state)来实现的,就像聊天机器人有一个“笔记本”,每次输入新信息时,它会在笔记本上记录下来,并用这些记录来生成回复。

RNN的局限性:短期记忆问题

虽然RNN能记住过去的信息,但它有一个问题:记性不好。如果对话很长,比如: - 你:“我叫小明,今年10岁。” - (过了十几轮对话后) - 你:“你记得我叫什么名字吗?” - 聊天机器人:“抱歉,我忘了。”

这是因为RNN在处理很长的对话时,容易“忘记”很久之前的信息。这种现象被称为长期依赖问题。为了解决这个问题,研究者发明了更强大的RNN变体,比如LSTM(长短期记忆网络)和GRU(门控循环单元),它们能更好地记住长期的信息。

总结:RNN就像一个“带记忆的盒子” 优点:能记住过去的输入,适合处理时序数据(比如聊天、语音、股票预测等)。 缺点:记性不好,容易忘记很久之前的信息(长期依赖问题)。

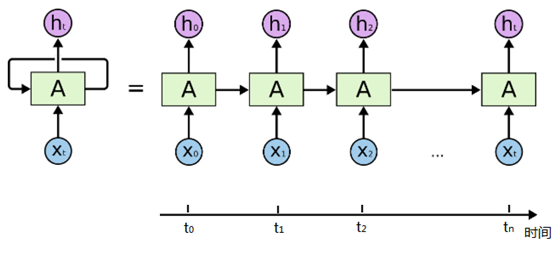

3.RNN网络结构

我们发现RNN比传统的神经网络多了一个循环圈,这个循环表示的就是在下一个时间步(Time Step)上会返回作为输入的一部分,我们把RNN在时间点上展开,得到的图形如下:

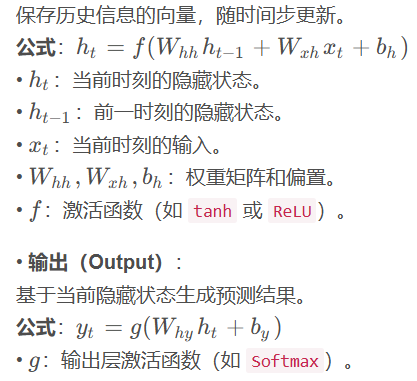

我们在看看RNN的记忆功能隐藏状态(Hidden State)是如何保持记忆力的:

我们不难理解RNN(循环神经网络)本质其实是引入了时间维度的概念,这也是它与传统前馈神经网络(Feedforward Neural Network,如多层感知机MLP)的最主要区别之一。然而,RNN的核心特性不仅仅是“增加了一个时间维度”,而是通过引入记忆机制来处理时序数据。

- 传统前馈神经网络的特点

- 输入和输出是独立的:每个输入和输出之间没有时间上的依赖关系。

- 没有记忆功能:网络无法记住之前的输入,只能基于当前输入进行计算。

-

固定输入输出:输入和输出的长度是固定的。

-

RNN的特点

- 引入时间维度:RNN能够处理动态长度的输入和输出,并捕捉时间上的依赖关系。

- 记忆机制:RNN通过隐藏状态(Hidden State)来“记住”过去的信息,并将这些信息用于当前的计算。

- 循环结构:RNN的神经元之间有循环连接,允许信息在时间上流动。

RNN的五种结构:

RNN(循环神经网络)的结构可以分为五种主要类型,每种类型适用于不同的任务。为了通俗易懂地理解这些结构,我们可以用生活中的例子来类比。 1. 一对一(Vanilla RNN) 特点:一个输入对应一个输出。 例子:天气预报。 今天输入“今天的温度是25°C”,输出“明天的温度可能是27°C”。 这是最简单的RNN结构,输入和输出都是单个数据点。 2. 多对一(Many-to-One) 特点:多个输入对应一个输出。 例子:情感分析。 输入一段文字:“这部电影真的太好看了,我非常喜欢!” 输出一个情感标签:“正面”。 RNN会逐字处理这段文字,最后输出一个情感标签。 3. 多对多(Many-to-Many,同步) 特点:多个输入对应多个输出,输入和输出长度相同。 例子:聊天机器人。 输入:“今天天气怎么样?适合出门吗?” 输出:“今天晴天,适合出门。” 每个输入的词都会影响输出的词,输入和输出的长度相同。 4. 一对多(One-to-Many) 特点:一个输入对应多个输出。 例子:图片描述生成。 输入一张图片(比如一只猫)。 输出一段描述:“这是一只可爱的猫,它正在睡觉。” 输入是一个静态的图片,但输出是一段动态的文字。 5. 多对多(Many-to-Many,异步) 特点:多个输入对应多个输出,输入和输出长度不同。 例子:机器翻译。 输入:“这是一本非常有趣的书。”(中文) 输出:“This is a very interesting book.”(英文) 输入和输出的长度可能不同,但RNN会根据输入的内容生成合适的输出。

总结 - 一对一:单个输入,单个输出(如简单预测)。 - 多对一:多输入,单输出(如情感分析)。 - 多对多(同步):多输入,多输出,长度相同(如聊天机器人)。 - 一对多:单输入,多输出(如图片描述生成)。 - 多对多(异步):多输入,多输出,长度不同(如机器翻译)。

4.简单示例(PyTorch实现)

目标:输入一个字符序列,预测下长度为5的字符串(如输入 “hel”,预测 “hello”)。

import torch

import torch.nn as nn

import numpy as np

# 1. 数据准备

text = "helloworld" #用来训练的语料库,简单 =>he --> hel

chars = list(set(text))

char_to_idx = {c: i for i, c in enumerate(chars)}

idx_to_char = {i: c for i, c in enumerate(chars)}

seq_length = 3 # 输入序列长度

# 2. 构建训练数据

inputs = []

targets = []

for i in range(len(text) - seq_length):

input_seq = text[i:i + seq_length]

target_char = text[i + seq_length]

inputs.append([char_to_idx[c] for c in input_seq])

targets.append(char_to_idx[target_char])

# 转换为张量

inputs = torch.LongTensor(inputs)

targets = torch.LongTensor(targets)

# 3. 定义RNN模型

class CharRNN(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(CharRNN, self).__init__()

self.hidden_size = hidden_size

self.embed = nn.Embedding(input_size, hidden_size) # 嵌入层

self.rnn = nn.RNN(hidden_size, hidden_size, batch_first=True)

self.fc = nn.Linear(hidden_size, output_size)

def forward(self, x, hidden):

x = self.embed(x) # (batch, seq_len) → (batch, seq_len, hidden_size)

out, hidden = self.rnn(x, hidden)

out = self.fc(out[:, -1, :]) # 取最后一个时间步的输出

return out, hidden

def init_hidden(self, batch_size):

return torch.zeros(1, batch_size, self.hidden_size)

# 超参数

input_size = len(chars)

hidden_size = 10

output_size = len(chars)

model = CharRNN(input_size, hidden_size, output_size)

criterion = nn.CrossEntropyLoss()

optimizer = torch.optim.Adam(model.parameters(), lr=0.01)

# 4. 训练模型

epochs = 100

for epoch in range(epochs):

hidden = model.init_hidden(inputs.size(0))

optimizer.zero_grad()

output, hidden = model(inputs, hidden)

loss = criterion(output, targets)

loss.backward()

optimizer.step()

if (epoch + 1) % 10 == 0:

print(f'Epoch [{epoch + 1}/{epochs}], Loss: {loss.item():.4f}')

# 5. 生成文本

def predict(model, start_str, length=10): #让它预测长度为5,最有肯定的单词是啥?

model.eval()

chars = [c for c in start_str]

with torch.no_grad():

hidden = model.init_hidden(1)

for _ in range(length-len(start_str)):

input_seq = torch.LongTensor([char_to_idx[c] for c in chars[-seq_length:]])

output, hidden = model(input_seq.unsqueeze(0), hidden)

prob = torch.softmax(output, dim=1)

next_char = idx_to_char[torch.argmax(prob).item()]

chars.append(next_char)

return ''.join(chars)

print("*"*10,"预测结果","*"*10)

#RNN最大的特点实现时间序列的预测

print(predict(model, "hel")) #'helloworld'

运行效果:

Epoch [10/100], Loss: 0.5226

Epoch [20/100], Loss: 0.1541

Epoch [30/100], Loss: 0.0548

Epoch [40/100], Loss: 0.0266

Epoch [50/100], Loss: 0.0171

Epoch [60/100], Loss: 0.0127

Epoch [70/100], Loss: 0.0103

Epoch [80/100], Loss: 0.0087

Epoch [90/100], Loss: 0.0076

Epoch [100/100], Loss: 0.0067

********** 预测结果 **********

helloworld

5.RNN总结

RNN 的最大特点在于它的循环结构和记忆功能,这使得它能够捕捉序列数据中的时间依赖关系。

以下是 RNN 的一些关键特点: - 循环结构:RNN 的核心特点是它在神经网络中引入了循环(recurrent)结构,允许网络在处理当前输入时参考之前的状态。这种结构使得 RNN 能够处理变长的序列数据。 - 记忆功能:RNN 通过隐藏状态(hidden state)来存储之前的信息,从而能够捕捉序列中的时间依赖关系。这种记忆功能是 RNN 能够处理时间序列数据的基础。 - 时间依赖建模:RNN 能够对序列数据中的时间依赖关系进行建模,这使得它在时间序列预测、自然语言处理(如语言建模、机器翻译)、语音识别等领域表现出色。 - 灵活性:RNN 的结构可以灵活调整,例如通过引入门控机制(如 LSTM 和 GRU),可以更好地处理长序列数据中的梯度消失和梯度爆炸问题。

时间序列预测是RNN的一个重要应用场景:

虽然时间序列预测是 RNN 的一个重要应用场景,但它并不是 RNN 的最大特点。时间序列预测只是 RNN 的循环结构和记忆功能在特定领域的应用之一。RNN 的最大特点仍然是它的循环结构和记忆功能,这些特点使得它能够处理各种序列数据,而不仅仅是时间序列数据。

总结: RNN 的最大特点是它的 循环结构 和 记忆功能,这使得它能够处理序列数据中的时间依赖关系。时间序列预测是 RNN 的一个重要应用场景,但并不是它的唯一特点或最大特点。