模型评估标准的核心其实就是衡量一个模型的好坏,合适的评价指标可以帮助我们准确地衡量模型的性能,从而进行优化和改进。

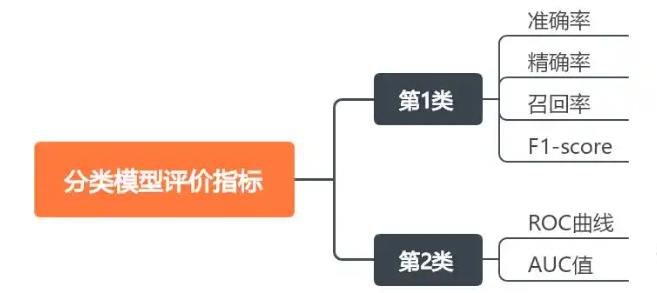

1.分类模型评价指标

在模型评估中,有多个标准用于衡量模型的性能,这些标准包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)、F1 分数(F1-Score)等。

真正例(True Positive, TP)

定义 :模型正确地预测为正类的样本数量。 通俗解释 :假设你有一个垃圾邮件分类器,它会把邮件标记为垃圾邮件或非垃圾邮件。真正例就是那些被正确标记为垃圾邮件的邮件数量。

例子 : 你有 100 封邮件。 其中 30 封是垃圾邮件。 模型正确地将 25 封垃圾邮件标记为垃圾邮件。 那么 TP = 25。

真负例(True Negative, TN)

定义 :模型正确地预测为负类的样本数量。 通俗解释 :假设你有一个垃圾邮件分类器,它会把邮件标记为垃圾邮件或非垃圾邮件。真负例就是那些被正确标记为非垃圾邮件的邮件数量。

例子 : 你有 100 封邮件。 其中 70 封是非垃圾邮件。 模型正确地将 60 封非垃圾邮件标记为非垃圾邮件。 那么 TN = 60。

假正例(False Positive, FP)

定义 :模型错误地预测为正类的样本数量。 通俗解释 :假设你有一个垃圾邮件分类器,它会把邮件标记为垃圾邮件或非垃圾邮件。假正例就是那些被错误地标记为垃圾邮件的非垃圾邮件数量。

例子 : 你有 100 封邮件。 其中 70 封是非垃圾邮件。 模型错误地将 10 封非垃圾邮件标记为垃圾邮件。 那么 FP = 10。

假负例(False Negative, FN)

定义 :模型错误地预测为负类的样本数量。 通俗解释 :假设你有一个垃圾邮件分类器,它会把邮件标记为垃圾邮件或非垃圾邮件。假负例就是那些被错误地标记为非垃圾邮件的垃圾邮件数量。

例子 : 你有 100 封邮件。 其中 30 封是垃圾邮件。 模型错误地将 5 封垃圾邮件标记为非垃圾邮件。 那么 FN = 5。

总结: - 真正例(TP) :模型正确预测为正类的样本数量。 - 真负例(TN) :模型正确预测为负类的样本数量。 - 假正例(FP) :模型错误预测为正类的样本数量。 - 假负例(FN) :模型错误预测为负类的样本数量。

这些概念是评估分类模型性能的基础,通过这些指标可以计算出准确率、精确率、召回率等更高级的评估指标。

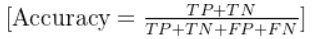

2.准确率

准确率(Accuracy)准确率是最直观的评估指标,它表示模型预测正确的样本占总样本的比例。计算公式为:

准确率简单易懂,但在类别不平衡的数据集中可能不够敏感。例如,在一个大多数样本都属于同一类别的数据集中,即使模型将所有样本都分类为这一多数类别,也能获得一个看似不错的准确率,但这并不意味着模型具有很好的区分能力。

from sklearn.metrics import confusion_matrix,accuracy_score

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

# 假设我们有以下真实标签和预测结果

y_true = np.array([2, 0, 2, 2, 0, 1])

y_pred = np.array([0, 0, 2, 2, 0, 2])

# 计算准确率

accuracy = accuracy_score(y_true, y_pred)

print("准确率:", accuracy)

运行结果:

准确率: 0.6666666666666666

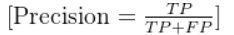

3.精确率(Precision)

精确率衡量模型预测为正类的实例中,实际为正类的比例。计算公式为:

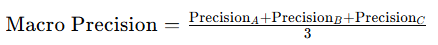

对应多分类问题,采样宏平均精确率是每个类别的精确率的平均值,不考虑每个类别的样本数量。计算公式如下:

精确率关注的是预测结果的准确性。在信息检索和许多其他领域中,精确率是一个重要的指标,因为它告诉我们检索结果的相关性有多高。一个高精确率意味着模型预测为正类的样本中,绝大多数实际上是正类。

from sklearn.metrics import confusion_matrix,accuracy_score,precision_score

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

# 假设我们有以下真实标签和预测结果

y_true = np.array([2, 0, 2, 2, 0, 1])

y_pred = np.array([0, 0, 2, 2, 0, 2])

# 计算精确率

precision = precision_score(y_true, y_pred, average='macro')

print("精确率:", precision)

运行结果:

精确率: 0.4444444444444444

4.召回率(Recall)

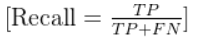

召回率衡量所有实际为正类的样本中,模型预测为正类的比例。计算公式为:

召回率关注的是模型捕捉正类样本的能力。在某些领域,如医疗诊断,召回率尤其重要,因为漏诊(假负例)的后果可能非常严重。

from sklearn.metrics import confusion_matrix,accuracy_score,precision_score,recall_score

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

# 假设我们有以下真实标签和预测结果

y_true = np.array([2, 0, 2, 2, 0, 1])

y_pred = np.array([0, 0, 2, 2, 0, 2])

# 计算召回率

recall = recall_score(y_true, y_pred, average='macro')

print("召回率:", recall)

运行结果:

召回率: 0.5555555555555555

5.F1 分数(F1-Score)

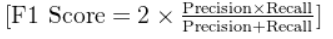

F1分数是精确率和召回率的调和平均值,它平衡了这两个指标。计算公式为:

F1分数在精确率和召回率都较高的算法上表现出色。它是一个综合指标,特别适用于那些对精确率和召回率都同样重视的场景。

from sklearn.metrics import confusion_matrix,accuracy_score,precision_score,recall_score,f1_score

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

# 假设我们有以下真实标签和预测结果

y_true = np.array([2, 0, 2, 2, 0, 1])

y_pred = np.array([0, 0, 2, 2, 0, 2])

# 计算准确率

accuracy = accuracy_score(y_true, y_pred)

print("准确率:", accuracy)

# 计算精确率

precision = precision_score(y_true, y_pred, average='macro')

print("精确率:", precision)

# 计算召回率

recall = recall_score(y_true, y_pred, average='macro')

print("召回率:", recall)

# 计算F1分数

f1 = f1_score(y_true, y_pred, average='macro')

print("F1分数:", f1)

运行结果:

准确率: 0.6666666666666666

精确率: 0.4444444444444444

召回率: 0.5555555555555555

F1分数: 0.48888888888888893

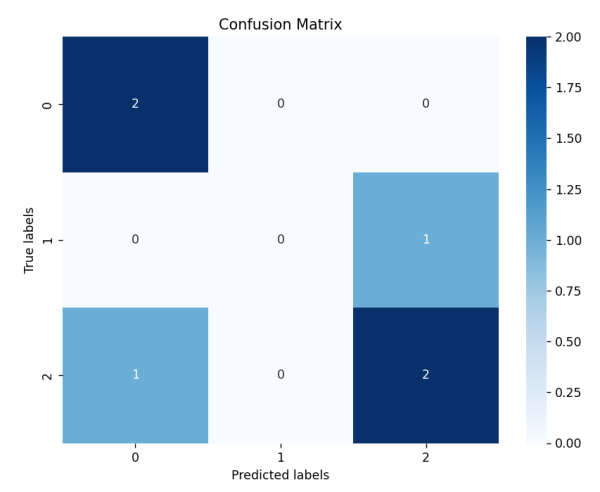

6.混淆矩阵

混淆矩阵是评估分类问题的基础工具,它是一个表格,显示了分类算法的预测结果与真实标签之间的关系。对于二分类问题,混淆矩阵包含真正例(TP)、真负例(TN)、假正例(FP)和假负例(FN)。这些值是计算其他评估指标的基础。混淆矩阵不仅提供了一个直观的视觉表示,还允许我们深入了解模型在各个类别上的表现,特别是当处理不平衡数据集时,混淆矩阵可以揭示模型是否倾向于错误地将一个类别分类为另一个类别。

from sklearn.metrics import confusion_matrix,accuracy_score,precision_score,recall_score,f1_score

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

# 假设我们有以下真实标签和预测结果

y_true = np.array([2, 0, 2, 2, 0, 1])

y_pred = np.array([0, 0, 2, 2, 0, 2])

# 计算准确率

accuracy = accuracy_score(y_true, y_pred)

print("准确率:", accuracy)

# 计算精确率

precision = precision_score(y_true, y_pred, average='macro')

print("精确率:", precision)

# 计算召回率

recall = recall_score(y_true, y_pred, average='macro')

print("召回率:", recall)

# 计算F1分数

f1 = f1_score(y_true, y_pred, average='macro')

print("F1分数:", f1)

# 计算混淆矩阵

cm = confusion_matrix(y_true, y_pred)

# 使用Seaborn的heatmap函数来可视化混淆矩阵

plt.figure(figsize=(8, 6))

sns.heatmap(cm, annot=True, fmt='d', cmap='Blues')

plt.xlabel('Predicted labels')

plt.ylabel('True labels')

plt.title('Confusion Matrix')

plt.show()

混淆矩阵是一个强大的工具,它通过展示模型预测结果与实际结果之间的对比,帮助我们直观地了解模型的分类效果。通过分析混淆矩阵,我们可以评估模型的总体表现、各类别的预测准确性、处理类别不平衡问题以及识别模型的错误类型,从而对模型进行改进和优化。

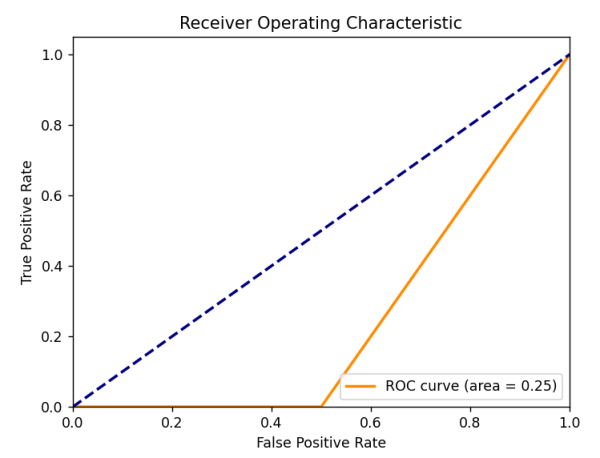

7.ROC曲线和AUC值

ROC曲线是一个性能度量,显示了在不同阈值设置下模型的真正例率(召回率)和假正例率的关系。AUC值表示ROC曲线下的面积,用于衡量模型的整体性能,AUC值越高,模型性能越好。ROC曲线和AUC值是评估模型区分不同类别能力的重要工具,尤其在二分类问题中非常实用。

from sklearn.metrics import roc_curve, roc_auc_score

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

import matplotlib.pyplot as plt

import numpy as np

# 假设我们有一个数据集

X = np.array([[0, 0], [1, 1], [2, 0], [2, 2], [0, 1]])

y = np.array([0, 1, 0, 1, 0])

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.5, random_state=42)

# 训练一个随机森林分类器

clf = RandomForestClassifier(n_estimators=100, random_state=42)

clf.fit(X_train, y_train)

# 预测概率

y_scores = clf.predict_proba(X_test)[:, 1]

# 计算ROC曲线和AUC值

fpr, tpr, thresholds = roc_curve(y_test, y_scores)

auc = roc_auc_score(y_test, y_scores)

# 绘制ROC曲线

plt.figure()

plt.plot(fpr, tpr, color='darkorange', lw=2, label='ROC curve (area = %0.2f)' % auc)

plt.plot([0, 1], [0, 1], color='navy', lw=2, linestyle='--')

plt.xlim([0.0, 1.0])

plt.ylim([0.0, 1.05])

plt.xlabel('False Positive Rate')

plt.ylabel('True Positive Rate')

plt.title('Receiver Operating Characteristic')

plt.legend(loc="lower right")

plt.show()

运行效果: