1.随机事件与随机事件概率

随机事件是指一个结果不确定的事件,即我们无法准确预测其具体结果。例如,掷骰子、抛硬币或者抽奖都是随机事件,因为我们无法提前知道会出现哪一面的骰子、硬币会是正面还是反面,或者我们会抽中哪个奖品。

随机事件概率是指某个随机事件发生的可能性大小。以抛硬币为例,我们知道硬币有两面:正面和反面。因此,抛硬币时出现正面或反面的概率都是一半,即 0.5 或 50%。概率通常用一个介于 0 到 1 之间的数值表示,0 表示不可能发生,1 表示一定会发生,0.5 表示有一半的可能性发生。

总而言之,随机事件是指结果不确定的事件,而随机事件概率则是指该事件发生的可能性大小,通常用一个介于 0 到 1 之间的数值表示。

2.条件概率与贝叶斯公式

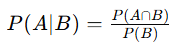

条件概率是针对于两个或更多个有相关关系/因果关系的随机事件而言的。它表示了在某种情况下,某一事件发生的可能性大小。数学上,条件概率通常用 P(A|B) 表示,表示在事件 B 已经发生的条件下,事件 A 发生的概率。简单来说,条件概率就是在已知一些信息的情况下,我们对事件发生的概率进行重新评估。

其中 P(A∩B) 是事件A和事件B同时发生的概率,P(B) 是事件B发生的概率。

贝叶斯公式是统计学中的一个重要公式,用于计算在给定某一事件的条件下,另一事件发生的概率。该公式被命名为贝叶斯,以纪念英国数学家托马斯·贝叶斯。

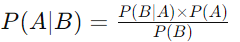

在贝叶斯公式中,我们有两个事件,通常称为A和B。A是我们想要计算的事件,B是已经发生或者我们有关于B的一些信息。贝叶斯公式可以表示为:

其中: - P(A|B)是在B发生的条件下A发生的概率,也就是我们想要计算的概率。 - P(B|A)是在A发生的条件下B发生的概率,通常称为似然。 - P(A)是A事件的先验概率,即在得到B的信息之前,我们对A的概率的估计。 - P(B)是B事件的先验概率,也就是在没有任何信息的情况下B发生的概率,需要通过全概率公式计算。

贝叶斯公式的核心思想是利用已知的结果,反推出原因的可能性。贝叶斯公式可以看作是全概率公式的逆向应用。

举个例子:

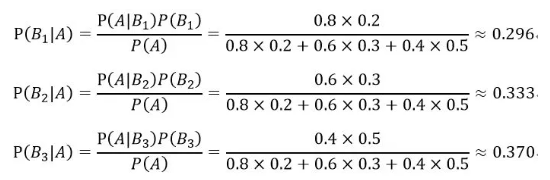

假设你有一个朋友小明,他有时候会迟到。你想知道他迟到的原因。你知道他迟到可能有三种原因:睡过头、堵车、赖床。

你还知道他睡过头、堵车、赖床的概率分别是0.2、0.3、0.5(这些就是先验概率)。

你还知道他在睡过头、堵车、赖床的情况下,迟到的概率分别是0.8、0.6、0.4(这些就是条件概率)。

那么,如果你知道他今天迟到了(这就是已知的结果),你可以用贝叶斯公式来求出他迟到的原因是睡过头、堵车、赖床的概率分别是多少(这些就是后验概率)。我们用A表示他迟到这个结果,用Bi表示第i个原因(i=1,2,3),那么根据贝叶斯公式,我们可以得到:

这样,我们就可以根据后验概率来判断他迟到的最可能的原因了。从上面的计算结果可以看出,他迟到的最可能的原因是懒床(后验概率最大),其次是堵车,最后是睡过头。

代码示例:

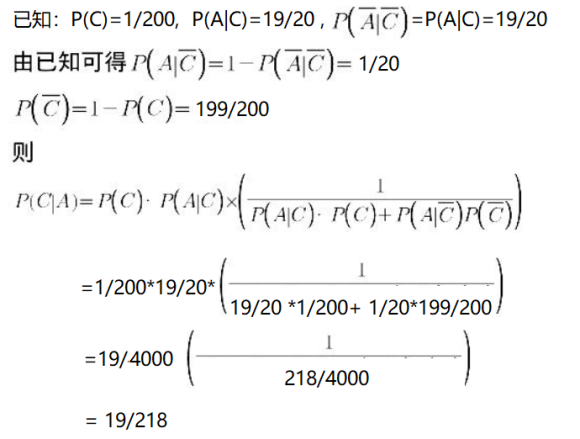

根据临床记录,某种诊断癌症的试验具有如下的效果:若以A 表示事件“试验反应为阳性”,以C表示事件“被诊断者患有癌症”,今对自然人群进行普查,设被试验的人患有癌症的概率P ( C )=1/200,P(A|C)=19/20,求P(C|A) 。

import numpy as np #导入numpy

from sympy import Rational as R #导入Rational

def bayes(prioProb, liklihood, i): #计算第i个因素Ai相对B的后验概率

temp=prioProb*liklihood #因素先验概率与对B的似然率按元素相乘

total=temp.sum() #B的先验概率

return temp[i-1]/total #Ai相对于B的后验概率

prioProb=np.array([R(1,200),R(199,200)])

likelihood=np.array([R(19,20), R(1, 20)])

p=bayes(prioProb,likelihood, 1)

print('P(C|A)=%s'%p)

运行结果:

P(C|A)=19/218

使用贝叶斯公式手工计算求解过程如下:

3.后验概率和先验概率

先验概率是实验或采样前基于已有知识和经验的概率估计,具有主观性和依赖性;后验概率是事件发生后,基于新信息对事件原因的概率估计,具有条件性和动态性,通常使用贝叶斯公式计算。

先验概率与后验概率的主要区别: 先验概率和后验概率的主要区别在于它们的计算依据和更新方式。先验概率是基于已有的知识和经验进行的估计,而后验概率则是在某件事情已经发生后,根据新获取的信息进行的重新估计。此外,先验概率通常具有主观性和依赖性,可能受到个人偏见和信息不完整等因素的影响;而后验概率则更加客观和动态,会随着新信息的出现而不断更新。

以医疗诊断为例,医生在诊断患者是否患有某种疾病时,通常会先根据患者的病史、家族遗传信息等先验知识,估计患者患病的概率。这个概率就是先验概率。然后,医生会通过实际的检查结果和临床表现等后验信息,来更新这个概率。这个更新后的概率就是后验概率。通过这个过程,医生可以更加准确地判断患者的病情,并制定出更加合适的治疗方案。

条件概率与贝叶斯的区别与联系:

侧重点:

- 条件概率公式侧重点在于已知某个事件发生的情况下,另一个事件发生的概率。

- 贝叶斯公式侧重点在于已知某个事件发生的情况下,反向计算另一个事件发生的概率。

应用场合: - 条件概率公式适用于直接计算已知条件下的概率。 - 贝叶斯公式适用于在已知结果的情况下,反推原因的概率,常用于机器学习、统计推断等领域。

公式形式: - 条件概率公式形式简单,直接使用交集概率和条件概率的定义。 - 贝叶斯公式形式更为复杂,涉及先验概率、似然概率和后验概率。

4.随机事件的独立性

随机事件的独立性是指两个或多个事件之间互不影响的性质。换句话说,当一个事件的发生与其他事件的发生或者不发生无关时,我们称这些事件是相互独立的。

具体而言,如果事件 A 和事件 B 是独立的,那么以下条件成立:

事件 A 的发生与事件 B 的发生无关,即P(A|B)=P(A) 事件 B 的发生与事件 A 的发生无关,即P(B|A)=P(B)

简而言之,两个事件的独立性意味着一个事件的发生不会影响另一个事件的概率,反之亦然。这种独立性在概率论和统计学中非常重要,因为它允许我们在计算复杂事件的概率时进行简化,从而更容易进行分析和推理。

5.随机变量

随机变量是在随机试验中可能出现的各种结果所对应的量,通常用来描述试验结果的数字特征。简单来说,它是对随机现象结果的一种数学抽象。

想象一下掷一枚骰子的情景。当你掷骰子时,可能会出现1、2、3、4、5 或 6 这些结果。这些结果就是随机变量,因为它们是随机试验的不同可能结果,并且可以用数字来表示。

随机变量可以分为两种类型:离散型和连续型。离散型随机变量的取值是有限的或者可数的,比如掷骰子的结果;而连续型随机变量的取值是无限的,通常用来描述测量结果,比如身高、体重等。

随机变量的重要性在于它们允许我们通过数学方法对随机试验的结果进行建模和分析,从而更好地理解和预测随机现象。